Konto bei Bitvavo eröffnen und 15 XRP gratis sichern

Bitvavo: Jetzt 15 XRP

Bonus sichern

Prominente Sprachmodelle wie OpenAI’s GPT-4 und Googles Bard erfüllen nicht die künstliche Intelligenz (KI)-Gesetzgebung der Europäischen Union (EU). Dies geht aus einer neuen Studie der Stanford University hervor. Diese Ergebnisse unterstreichen den Mangel an Transparenz und Einhaltung von Vorschriften sowie die potenziellen Auswirkungen der europäischen KI-Regulierung auf die Industrie. Transparenz wird zunehmend als wesentliche Grundlage für eine verantwortungsvolle Anwendung von KI anerkannt.

In der jüngsten Studie wurden sowohl OpenAI’s GPT-4 als auch Googles Bard von den Forschern gnadenlos kritisiert. Das Fazit lautet, dass keines dieser prominenten Sprachmodelle derzeit den Vorschriften entspricht, die im „Gesetz über Künstliche Intelligenz (KI)“ der Europäischen Union (EU) festgelegt sind.

Diese bahnbrechende Gesetzgebung, die die erste ihrer Art ist und KI sowohl auf nationaler als auch auf regionaler Ebene reguliert, wurde kürzlich vom Europäischen Parlament einstimmig verabschiedet. Die EU-KI-Verordnung beschränkt sich nicht nur auf die Regulierung von KI innerhalb der EU mit einer Bevölkerung von etwa 450 Millionen Menschen, sondern dient auch als wegweisender Leitfaden für die weltweite KI-Regulierung.

Dennoch haben KI-Unternehmen laut der jüngsten Stanford-Studie noch erhebliche Fortschritte zu erzielen, um die Gesetzgebung einzuhalten.

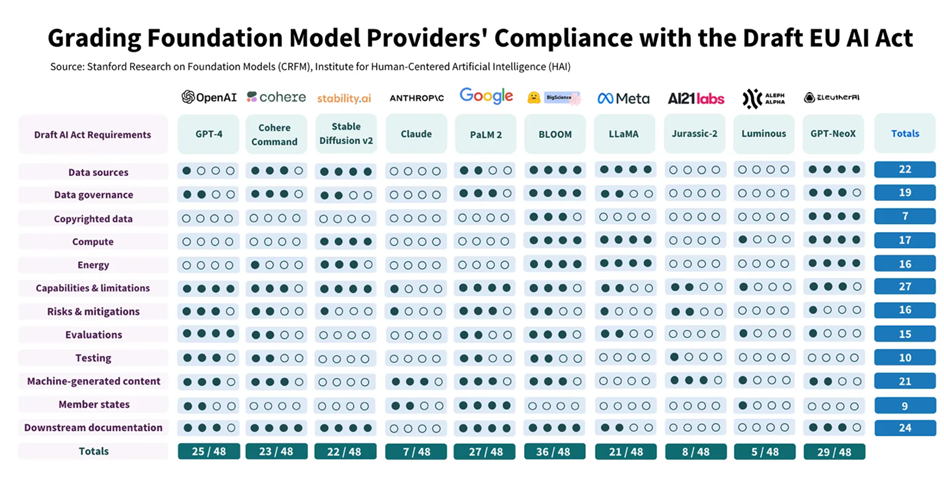

Die Forscher haben in ihrer Studie zehn führende Anbieter von Sprachmodellen bewertet. Auf einer Skala von 0 bis 4 wurde bewertet, inwieweit jeder Anbieter den 12 Anforderungen der KI-Gesetzgebung entsprach.

Die Ergebnisse zeigen eine erhebliche Diskrepanz in der Einhaltung der Gesetzgebung, wobei einige Anbieter nur 25% oder weniger in Bezug auf die Einhaltung erreichten, während nur ein Anbieter, nämlich Hugging Face/BigScience, eine Bewertung von mehr als 75% erzielte.

Dennoch zeigt sich, dass selbst die Anbieter mit den höchsten Bewertungen noch erhebliches Verbesserungspotenzial haben.

Die durchgeführte Studie wirft ein aufschlussreiches Licht auf verschiedene entscheidende Aspekte der Nichteinhaltung. Die Forscher haben besorgniserregende Feststellungen hinsichtlich mangelnder Transparenz bei der Offenlegung des Status urheberrechtlich geschützter Trainingsdaten, des Energieverbrauchs, der erzeugten Emissionen und der angewandten Methoden zur Begrenzung potenzieller Risiken gemacht.

Darüber hinaus hat das Team eine klare Ungleichheit zwischen offenen und geschlossenen Modellveröffentlichungen festgestellt. Offene Veröffentlichungen neigen dazu, eine robustere

Offenlegung von Ressourcen zu ermöglichen, bringen aber auch größere Herausforderungen bei der Überwachung und Kontrolle ihrer Verwendung mit sich.

Das Fazit von Stanford lautet, dass alle Anbieter ihr Verhalten verbessern können, unabhängig von der Methode, die sie zur Veröffentlichung ihrer Modelle verwenden.

In den letzten Monaten wurde ein bemerkenswerter Rückgang des Maßes an Transparenz bei großen Modellveröffentlichungen festgestellt. Zum Beispiel hat OpenAI keine Informationen über die verwendeten Daten und Berechnungen in ihren GPT-4-Berichten zur Verfügung gestellt, mit dem Argument eines wettbewerbsintensiven Umfelds und Sicherheitsimplikationen.

Obwohl diese Erkenntnisse von erheblicher Bedeutung sind, passen sie auch in einen breiteren Kontext. In letzter Zeit hat OpenAI aktiv versucht, die Einstellung verschiedener Länder zur KI zu beeinflussen, was angesichts dieser Entdeckungen nicht zu vernachlässigen ist. Als führender Technologiegigant hat OpenAI sogar damit gedroht, Europa zu verlassen, wenn die KI-Regulierung zu streng würde – eine Drohung, die später zurückgezogen wurde. Solche Maßnahmen unterstreichen die komplexe und oft heikle Beziehung zwischen Anbietern von KI-Technologie und Regulierungsbehörden.

Die Forscher haben mehrere Empfehlungen zur Verbesserung der KI-Regulierung formuliert. In Bezug auf EU-Politiker ist es von entscheidender Bedeutung, dass die KI-Gesetzgebung Anbieter von groß angelegten Modellarchitekturen für Transparenz und Rechenschaftspflicht verantwortlich macht. Darüber hinaus wird die Notwendigkeit von technologischen Ressourcen und qualifiziertem Personal betont, um die Durchsetzung dieser Gesetzgebung zu gewährleisten, wobei die Komplexität des KI-Ökosystems zum Ausdruck kommt.

Laut den Forschern liegt die größte Herausforderung in der Fähigkeit der KI-Anbieter, ihre Geschäftspraktiken schnell anzupassen und weiterzuentwickeln, um den gesetzlichen Anforderungen gerecht zu werden. Ohne strengen Regulierungsdruck können viele Anbieter durch sinnvolle, aber plausible Änderungen ordnungsgemäß hohe Bewertungen erzielen – irgendwo zwischen 30 und 40 Punkten auf einer Skala von 48.

Die Arbeit der Forscher bietet einen tiefen Einblick in die Zukunft der KI-Regulierung. Sie stellen fest, dass die Umsetzung und Durchsetzung der KI-Gesetzgebung einen erheblichen positiven Einfluss auf das Ökosystem haben und den Weg zu mehr Transparenz und Rechenschaftspflicht ebnen wird.

KI transformiert die Gesellschaft mit ihren beispiellosen Möglichkeiten und inhärenten Risiken. Während die Welt kurz davor steht, diese bahnbrechende Technologie zu regulieren, wird immer deutlicher, dass Transparenz nicht nur eine optionale Ergänzung ist, sondern eine wesentliche Grundlage für eine verantwortungsvolle Anwendung von KI darstellt.

Vietnamesische Behörden verhaften Verdächtige hinter der Krypto-Plattform ONUS wegen Milliardenbetrugs. Das Netzwerk manipulierte Tokenpreise und täuschte Millionen Anleger mit irreführender Werbung.

Die britische Regierung hat Sanktionen gegen Xinbi verhängt, einen chinesischen Kryptomarktplatz mit einem geschätzten Wert von 20 Milliarden Dollar.

Die Krypto-Industrie verstärkt ihren politischen Einfluss in den USA im Vorfeld der Zwischenwahlen 2026.

KI prognostiziert einen Anstieg des XRP-Kurses auf 4 bis 8 Dollar, sobald alle Ripple-Tokens freigegeben sind, mit einer möglichen Aussicht auf 15 Dollar.

KI-Modelle sagen einen Anstieg des XRP-Kurses bis April voraus. Trotz Unsicherheiten bleibt die Stimmung auf dem Kryptomarkt vorsichtig optimistisch.

Polymarket-Trader erwarten überwiegend weiteren Druck auf XRP, obwohl eine kleine Gruppe noch auf eine überraschende Rally bis April setzt.